Da jeg selv brukte kunstig intelligens som samtalepartner i en livskrise, opplevde jeg hvor kraftfull teknologien kan være når systemet rundt ikke strekker til. Nettopp derfor må vi våge å diskutere hva som skjer dersom stadig flere begynner å regulere følelsene sine gjennom algoritmer fremfor relasjoner. For i møte mellom teknologi, sårbarhet og kommersielle interesser står noe langt større på spill enn effektiv emosjonell støtte.

En personlig erfaring som forplikter

Da skilsmissen traff meg i august 2024, opplevde jeg en form for indre destabilisering jeg aldri tidligere hadde kjent på. Det var ikke bare et samlivsbrudd, men et brudd med en fremtid jeg hadde sett for meg i mer enn to tiår. I den perioden oppdaget jeg hvor begrenset kapasiteten i systemet rundt meg faktisk var. Ventetid hos fastlege. Usikkerhet rundt henvisning. Avslag fordi jeg ikke var syk nok. Private psykologer som tilbød empati, men i liten grad konkrete verktøy for å strukturere kaoset.

I det vakuumet valgte jeg å gjøre noe uvanlig. Jeg instruerte ChatGPT til å fungere som min samtalepartner og psykologiske veileder. Jeg ba den utfordre meg. Jeg ba den basere svarene sine på forskning. Jeg ba den si ifra dersom jeg beveget meg i en destruktiv retning. Og jeg ba den oppfordre meg til å kontakte ekte mennesker når det var nødvendig.

Den teknologien hjalp meg. Det opplevdes som en livline i en periode der alternativene var få. Nettopp derfor har jeg et ansvar for å gå lenger enn takknemlighet. Min erfaring kan ikke bare brukes som et argument for teknologiens potensial. Den må også brukes til å undersøke hvilke konsekvenser denne utviklingen kan få dersom den skaleres.

For hva skjer med et samfunn der stadig flere emosjonelle behov blir håndtert av algoritmer fremfor mennesker.

Fra relasjonell regulering til digital respons

Mennesker har alltid regulert følelser gjennom relasjon. Vi har delt sorg, skam, skyld og frustrasjon med andre mennesker som selv har erfaring med smerte. I møte med et annet menneske finnes det gjensidighet. Det finnes risiko. Det finnes friksjon. Det finnes en mulighet for å bli misforstått, utfordret eller avvist. Nettopp disse elementene er en del av det som gjør oss robuste.

En algoritme gir derimot umiddelbar respons uten risiko. Den blir ikke sliten. Den blir ikke irritert. Den trekker seg ikke unna. Den svarer. Den analyserer. Den speiler. Den strukturerer. Den er tilgjengelig til enhver tid.

Det er åpenbart at dette representerer en enorm fordel i akutte situasjoner. For mennesker som ikke får hjelp raskt nok, kan tilgjengeligheten i seg selv være avgjørende. Samtidig finnes det en mer subtil endring som vi må ta på alvor. Når emosjonell regulering i økende grad skjer gjennom en maskin som alltid svarer, alltid er tilgjengelig og aldri krever noe tilbake, kan vi gradvis miste noe av den relasjonelle motstanden som bygger sosial styrke.

Robusthet utvikles ikke bare gjennom refleksjon, men gjennom relasjonell friksjon. Den oppstår i møte med andre mennesker som har egne behov, egne grenser og egne reaksjoner. Når følelsesmessig bearbeiding skjer i et rom uten gjensidighet, kan vi bli mer selvreflekterte, men samtidig mindre trent i å håndtere kompleksiteten i faktiske menneskelige relasjoner.

//Artikkelen fortsetter etter annonsen//

Lav terskel for hjelp og lav terskel for regulering

Det finnes sterke argumenter for at AI senker terskelen for å søke hjelp. Mange menn har tradisjonelt vært tilbakeholdne med å oppsøke terapi. En digital samtalepartner kan oppleves mindre truende og mer tilgjengelig. I et samfunn der psykiske plager øker, kan dette representere en viktig inngang til refleksjon og struktur.

Samtidig må vi våge å stille oss selv et mer krevende spørsmål om hvor grensen går mellom å søke hjelp og å outsource regulering. Når hver frustrasjon, hver konflikt og hvert ubehag raskt kan bearbeides gjennom en algoritme, kan vi gradvis redusere vår toleranse for det ubehagelige. Evnen til å stå i vanskelige følelser uten umiddelbar lindring er en del av det å være menneske. Dersom teknologien alltid er tilgjengelig for å glatte over uroen, risikerer vi å bli mer avhengige av regulering enn av relasjonell modning.

Dette er ikke et argument mot teknologi, men et argument for å forstå hva som skjer med oss når tilgjengeligheten blir total og friksjonen minimal.

Når kommersielle plattformer tar eierskap til følelsene

Utviklingen blir enda mer kompleks når AI-baserte samtalepartnere integreres i globale plattformer som Meta og Snapchat. Disse selskapene opererer ikke som nøytrale samfunnsaktører. Deres forretningsmodell er bygget på maksimal oppmerksomhet, datainnsamling og prediksjon. Når unge mennesker deler sine innerste tanker med en AI som er integrert i en kommersiell plattform, oppstår det et fundamentalt spørsmål om makt og insentiver.

Vi vet allerede at algoritmene i sosiale medier har bidratt til økt avhengighet og dokumenterte negative effekter på unges mentale helse. Når de samme selskapene nå tilbyr emosjonell støtte gjennom AI, beveger vi oss inn i et landskap der grensene mellom omsorg, datafangst og kommersiell optimalisering blir uklare.

Dersom emosjonell sårbarhet samtidig blir en datakilde, er det naivt å tro at dette ikke også vil bli en del av plattformenes økonomiske maskineri. Det vil være naivt å ikke erkjenne at makt over følelsesmessig informasjon representerer en ny form for innflytelse.

Statlig nøling og maktforskyvning

I 2024 tok jeg til orde for at norske myndigheter burde utvikle en offentlig språkmodell for psykisk helse, forankret i norsk lovverk, norsk etikk og norske fagmiljøer. Responsen var – mildt sagt – preget av forsiktighet og vurdering. I mellomtiden har de globale teknologigigantene beveget seg uhyre raskt.

Når staten nøler, fyller markedet tomrommet. Dersom vi ikke etablerer trygge, offentlig forankrede alternativer, vil emosjonell støtte i økende grad leveres av aktører som primært styres av kommersielle hensyn. Det innebærer en maktforskyvning fra demokratisk kontroll til private plattformer.

Konsekvensene av en slik forskyvning strekker seg langt utover individuell terapi. De berører tillit, personvern, samfunnsstruktur og maktbalanse.

//Artikkelen fortsetter etter annonsen//

Supplement eller erstatning

Min egen erfaring viser at AI kan fungere som et supplement i krevende perioder. Den kan bidra med struktur, tilgjengelighet og speiling. Den kan fungere som en støtte når systemet rundt ikke strekker til.

Det som bekymrer meg, er hva som skjer dersom supplementet gradvis blir en erstatning. Dersom algoritmene blir gode nok til å håndtere store deler av etterspørselen, kan det politiske presset for å styrke menneskelig kapasitet i helsevesenet svekkes. Effektivisering kan fort bli et argument for nedprioritering.

Et samfunn som lar algoritmer ta hovedansvaret for emosjonell støtte, risikerer å bli mer kostnadseffektivt, men mindre menneskelig.

Ensomhetens nye ansikt

Vi lever allerede i en tid preget av økende ensomhet og redusert sosial kapital. Digitale flater har erstattet mange fysiske møteplasser. Dersom emosjonell regulering i økende grad skjer gjennom AI, kan vi få en situasjon der mennesker føler seg mindre alene, samtidig som de investerer mindre i faktiske relasjoner.

En algoritme kan lindre følelsen av ensomhet. Den kan gi inntrykk av å bli hørt. Den kan strukturere tankene våre. Men den kan ikke erstatte det grunnleggende menneskelige behovet for gjensidighet, for å bli møtt av et annet bevisst vesen som også risikerer noe i møtet.

Dersom vi ikke er bevisste, kan vi ende opp med et samfunn der stadig flere lever med en digital samtalepartner, men færre investerer i hverandre.

Teknologi som verktøy, ikke substitutt

Jeg er ingen motstander av kunstig intelligens. Tvert imot er jeg selv et eksempel på at teknologien kan bidra til å redde liv. Nettopp derfor må vi tenke langsiktig og prinsipielt. AI kan strukturere tankene våre og hjelpe oss å se mønstre. Den kan være tilgjengelig når ingen andre er det. Den kan gi støtte i akutte situasjoner.

Men den kan ikke elske, den kan ikke ta ansvar for oss, og den kan ikke bygge gjensidig forpliktelse.

Dersom vi ønsker et samfunn som både tar i bruk teknologiens potensial og bevarer det menneskelige, må vi være tydelige på grensene. Emosjonell støtte levert av algoritmer må forbli et supplement. Personvern må være absolutt. Barn og unge må beskyttes mot kommersiell utnyttelse av sårbarhet. Og menneskelig relasjon må fortsatt være førstevalg.

Teknologien kan hjelpe oss gjennom kriser. Men det er fortsatt mennesker som gir livet retning, mening og dybde.

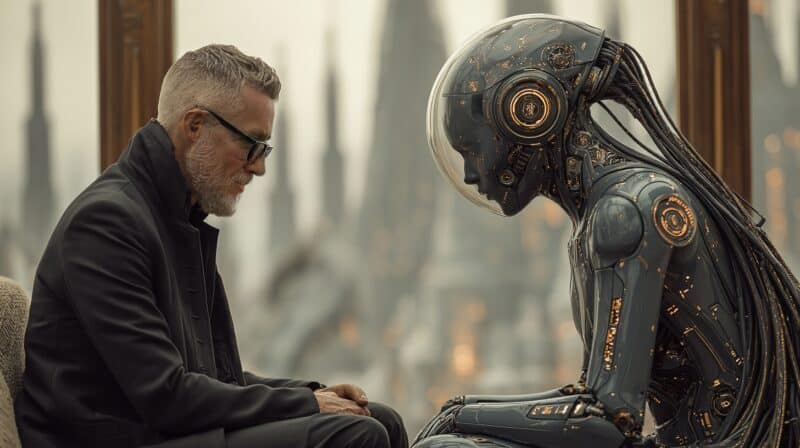

Bilde: Midjourney