Fra post-fakta til post-litteratur og post-virkelighet: Samfunnets langsomme kollaps i tre akter

Overgangen fra «jeg leste det i leksikonet» til «jeg spurte ChatGPT» avslører store kognitive skifter. Det er praktisk å spørre kunstig intelligens om svaret, men det innebærer også at vi overlater vår tenkning til en kommersiell språkmodell vi ikke vet om vi kan stole på. Det er en utvikling som bør bekymre oss.

Da jeg vokste opp på 70- og 80-tallet, var det vanlig å si at man hadde lest noe i leksikonet. Den setningen ga en egen tyngde. Leksikonet representerte kunnskap som var kvalitetssikret av fagfolk, og henvisningen til det ga en form for autoritet.

Med internett ble det snart mer naturlig å si at man hadde lest noe på nettet. Denne setningen bar ikke på samme tyngde, for alle visste at nettet rommet både gull og grums. Etter hvert ble det mer presist å si at man hadde googlet seg frem til et svar, eller at man hadde lest det på Wikipedia. Google ble inngangsporten, mens Wikipedia ble fellesskapets leksikon. Den var åpen og dynamisk, men samtidig omdiskutert.

I dag, snart tre år etter lanseringen av ChatGPT, har vi tatt enda et steg. Nå hører jeg nesten konsekvent at de jeg møter og snakker med sier at de spurte ChatGPT.

Dette lille språkskiftet rommer et stort tankeskifte. Når vi tidligere sa at vi hadde lest noe, lå det implisitt at vi hadde gjort en jobb selv. Vi hadde søkt opp informasjon, vurdert kilder og resonnerte over innholdet. Når vi nå sier at vi spurte ChatGPT, hopper vi over flere ledd. Vi får ikke lenger rå informasjon som vi må bearbeide selv. I stedet får vi en ferdig formulert tekst, og det med et språk som virker både sikkert og overbevisende.

Dette markerer et viktig skifte fra informasjonssamfunnet til algoritmesamfunnet. Fra en kunnskapsøkonomi til en fortolkningsøkonomi. Språkmodeller gir oss ikke bare fakta, men også forklaringer og sammenhenger, og av og til til og med råd. Det er praktisk, men det innebærer også at vi outsourcer store deler av vår egen tenkning.

Forfatteren og journalisten Nicholas Carr beskrev allerede i 2010, i boken The Shallows, hvordan internett påvirket hjernens evne til fordypning. Med kunstig intelligens tar vi dette enda lengre. Risikoen er ikke bare at konsentrasjonen svekkes, men at selve evnen til kritisk vurdering gradvis uthules. I stedet for å spørre hva ulike kilder sier, eller hvordan vi kan vurdere informasjon selv, nøyer vi oss ofte med ett enkelt svar. Vi vender oss til å sitere ChatGPT. Dermed overlater vi ikke bare lagringen av kunnskap til teknologien, men også deler av selve refleksjonen.

I leksikonets tid bygget vi vår tillit på institusjoner som forlag, redaktører og fagmiljøer. De var ikke feilfrie, men vi visste hvem som sto bak. Med ChatGPT er situasjonen en annen. Vi stoler på en kommersiell, lukket språkmodell. Vi vet lite om treningsdataene, lite om prioriteringene og lite om hvordan svarene formes. Likevel legger vi en form for autoritet i utsagnet om at vi spurte ChatGPT.

Her blir den franske filosofen Michel Foucaults tanker om kunnskap og makt svært relevante.

Den som kontrollerer kunnskapsproduksjonen, kontrollerer også virkelighetsforståelsen.

Når denne makten samles hos noen få teknologigiganter, får det konsekvenser som strekker seg langt utover enkeltpersonens informasjonsbehov. Det angår både demokratiet og offentligheten.

Denne utviklingen kan beskrives i tre faser.

Parallelt har vårt forhold til sannhet endret seg. På nettet måtte vi selv navigere og vurdere. Med ChatGPT får vi svaret ferdig innpakket. Resultatet er et paradoks. Svaret er egentlig mer usikkert enn noen gang, men fordi det presenteres i et flytende og selvsikkert språk, oppleves det som mer absolutt.

Det leder meg til et stort og viktig spørsmål om hva som skjer med vår intellektuelle autonomi når vi outsourcer stadig mer av vår kognitive prosess? På den ene siden frigjør det tid og energi. Vi slipper å lete i timevis etter informasjon. På den andre siden risikerer vi å svekke evnen til kritisk refleksjon. Hvis vi vender oss til at kunstig intelligens alltid formulerer svaret for oss, hva skjer da med vår evne til å tvile, reflektere og være uenig? I ytterste konsekvens kan vi ende opp med tanker som ikke lenger er våre egne, men som er samproduserte med, og delvis eid av, kommersielle språkmodeller.

Dette betyr ikke at vi skal avvise kunstig intelligens. Språkmodeller er kraftfulle verktøy som kan øke produktiviteten, gjøre kunnskap mer tilgjengelig og åpne nye kreative rom. Samtidig må vi stille de vanskelige spørsmålene:

Overgangen fra å si at vi leste noe i leksikonet til å si at vi spurte ChatGPT viser hvordan små språklige endringer avslører store kognitive og kulturelle skifter. Nettopp derfor må vi reflektere kritisk over hvordan vi bruker kunstig intelligens. For spørsmålet er ikke bare hva ChatGPT kan svare oss på.

Spørsmålet er også hva vi mister, hvis vi slutter å svare selv.

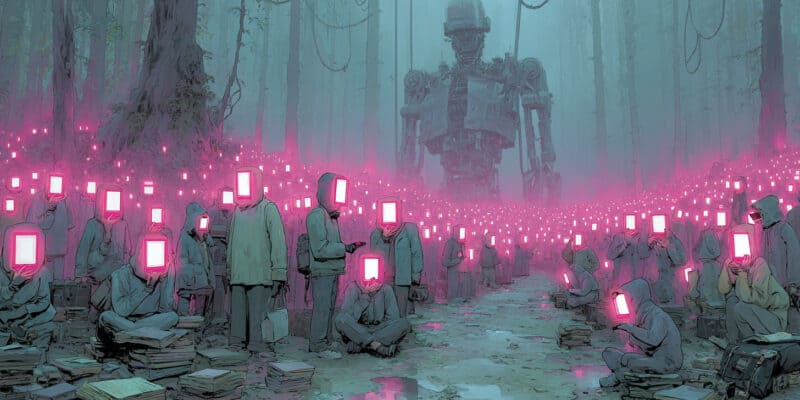

Bilde: MIdjourney